LLMs: Warum Entwickler jetzt Code-Leser sein müssen

Code schreiben war gestern – jetzt zählt das Verstehen dank LLMs.

In der Welt der Softwareentwicklung findet ein Paradigmenwechsel statt. Large Language Models (LLMs) haben die Art und Weise, wie Code produziert wird, radikal verändert und Entwickler dazu gezwungen, ihre Prioritäten neu zu überdenken. Der traditionelle Fokus auf das Schreiben neuen Codes wird von der Notwendigkeit, bestehenden Code zu verstehen, in den Schatten gestellt – eine Fähigkeit, die immer wichtiger wird, aber oft unterschätzt bleibt.

Die neue Realität

Jahrelang galt das Schreiben neuen Codes als Hauptaufgabe der Entwickler. Doch da LLMs, wie die von OpenAI oder Google, mühelos Hunderte von Codezeilen erzeugen, hat sich der Schwerpunkt verlagert. Entwickler stehen nun vor der Herausforderung, große Mengen automatisch generierten Codes zu verstehen – eine Aufgabe, die konzentrierte Aufmerksamkeit und tiefes Verständnis der zugrunde liegenden Systeme erfordert.

Mikrofone, Webcams und Zubehör, die KI-Creator täglich nutzen.

Code verstehen wird wichtiger als ihn zu schreiben. Das mentale Modell, das zum Schreiben benötigt wird, ist kompakt im Vergleich zu dem Aufwand, der für das Lesen und Verstehen von LLM-Code nötig ist.

Warum Lesen entscheidend ist

Joel Spolsky, eine bekannte Persönlichkeit in der Tech-Community, hob in seinem berühmten Essay "Things You Should Never Do, Part I" die Gefahren des Neuschreibens von Code hervor. Seine Einsichten sind nach wie vor relevant. Der Drang, Code neu zu schreiben, anstatt ihn zu lesen und zu verstehen, kann zu kostspieligen Fehlern führen, wie das Beispiel von Netscapes Untergang in den frühen 2000ern zeigt.

Das gleiche Prinzip gilt auf individueller Ebene. Entwickler neigen oft dazu, Code zu refaktorisieren oder zu ersetzen, ohne seine aktuelle Funktionalität vollständig zu erfassen. Diese Tendenz wird durch die schnellen Codeerzeugungsfähigkeiten von LLMs verstärkt, die mehr Code produzieren, als schnell geprüft oder verstanden werden kann.

Die Auswirkungen von LLMs

Das Aufkommen von LLMs hat eine Asymmetrie zwischen Code-Erzeugung und -Verstehen geschaffen. Während die Code-Erzeugung günstiger und schneller geworden ist, bleibt die kognitive Belastung des Verstehens unverändert. Diese Diskrepanz stellt eine Herausforderung für Code-Review-Prozesse dar, die nicht auf das enorme Volumen automatisch generierten Codes vorbereitet sind.

Große Codebasen erfordern gründliches Verständnis, nicht nur eine oberflächliche Überprüfung. Der Wechsel von inhaltsgetriebenen zu zeremoniellen Review-Prozessen birgt das Risiko von Fehlern und Ineffizienzen.

Kontext: Die europäische Perspektive

In der europäischen Tech-Landschaft, wo regulatorische Rahmenbedingungen wie die DSGVO strenge Compliance-Anforderungen stellen, ist das Verstehen von Code nicht nur eine technische Notwendigkeit, sondern auch eine rechtliche. Europäische Entwickler müssen sicherstellen, dass automatisch generierter Code den Datenschutz- und Sicherheitsstandards entspricht, was die Aufgabe des Lesens noch komplexer macht.

Was das für Dich bedeutet

Wenn Du Entwickler bist, solltest Du mehr Zeit für das Verständnis von Code einplanen. Das könnte bedeuten, dass Du Deine Fähigkeiten im Lesen und Verstehen von Code schärfen musst, anstatt Dich nur auf das Schreiben zu konzentrieren. Unternehmen könnten auch in Schulungen und Tools investieren müssen, die ein besseres Codeverständnis erleichtern.

Was noch unklar ist

- Wie werden Bildungsprogramme darauf reagieren, um Lesefähigkeiten zu betonen?

- Werden LLMs sich weiterentwickeln, um das Verstehen von Code genauso effektiv zu unterstützen wie dessen Erzeugung?

- Wie wird die Branche das Bedürfnis nach schneller Code-Erzeugung mit der Notwendigkeit des Code-Verstehens in Einklang bringen?

Warum das wichtig ist

LLMs haben das Gleichgewicht zwischen Schreiben und Lesen von Code verändert. Entwickler müssen sich an diese neue Realität anpassen, in der das Verstehen von Code oberste Priorität hat. Die Branche muss diesen Wandel erkennen und angehen, um zukünftige Fallstricke im Zusammenhang mit schneller Code-Erzeugung und unzureichendem Code-Verständnis zu vermeiden.

Mikrofone, Webcams und Zubehör, die KI-Creator täglich nutzen.

AI-Gear ansehen →Eine kurze Mail. Die wichtigsten AI-Nachrichten, faktengeprüft, ohne Fülltext. Kostenlos, jederzeit abbestellbar.

Mehr aus AI

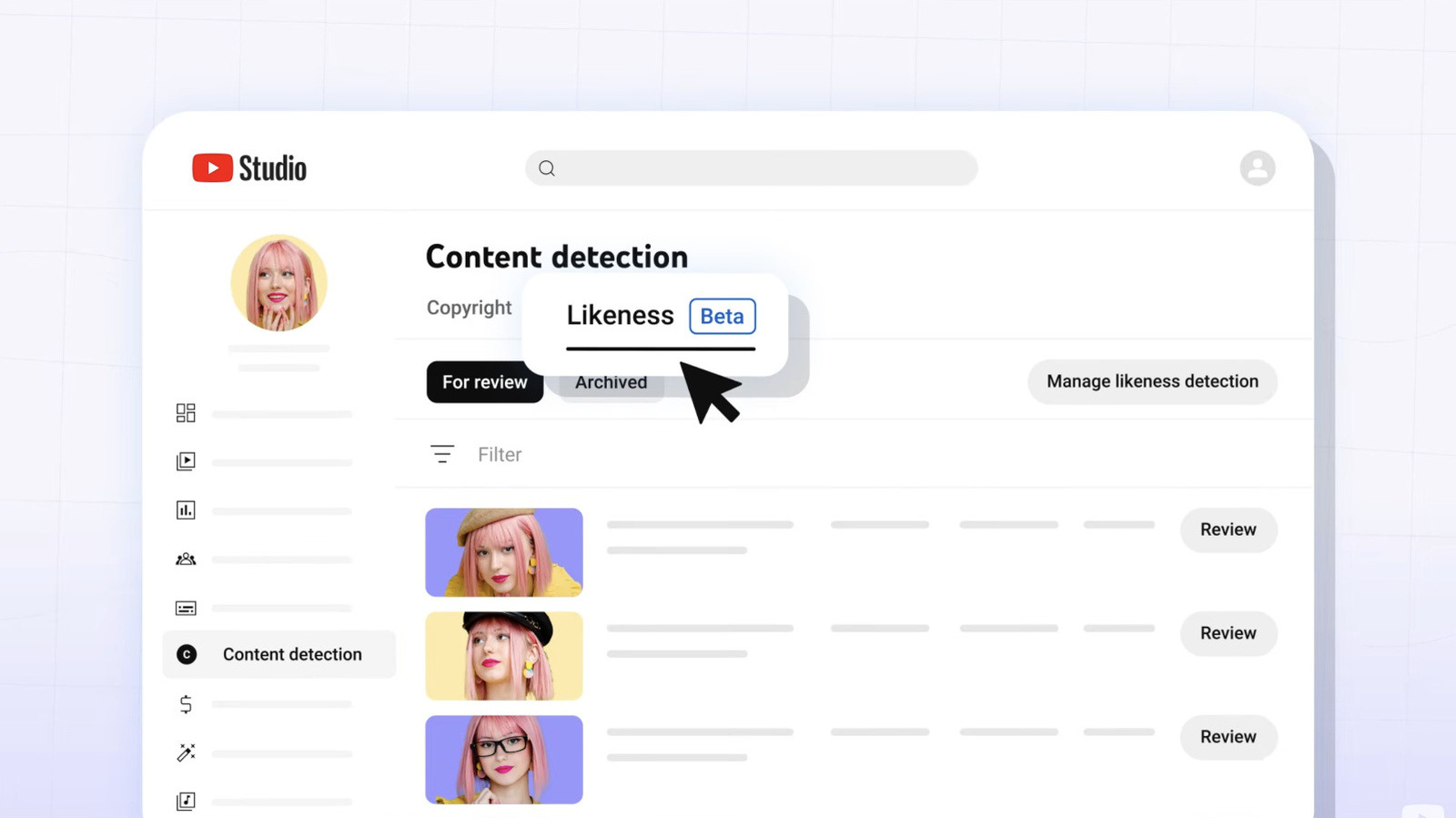

YouTube Expands AI Deepfake Tool to All Creators 18+

YouTube's AI tool helps creators spot deepfakes using their likeness, now available to all users over 18, enhancing content protection.

German Doctors Warn EU AI Rules Weaken Data Privacy

Germany's top doctors are sounding the alarm over the EU's proposed changes to data privacy, pushing for much stricter AI and cloud regulations in healthcare. They're worried about patient trust.

AI Chatbots: Your Data Is Showing

Think your data's safe? Think again. AI models like ChatGPT and Gemini are spilling personal details, exposing more than just search results.

Google Gemini AI Simplifies Lease Jargon for New Renters

Renting your first property? Gemini AI can simplify the jargon in lease agreements, making it easier to understand and negotiate.

Auch interessant

Xiaomi 15 Ultra vs iPhone 17 Pro Max: Which Flagship Earns Its Price?

Xiaomi 15 Ultra and iPhone 17 Pro Max bring top-tier features. Discover how they differ and which fits your priorities best.

Samsung Workers Threaten Strike Over Profit Sharing Dispute

Samsung's chip division workers threaten to strike for 18 days, spotlighting tensions over profit sharing.

Starry Nights & City Lights: Heise's Best Photos of the Week

Heise's weekly photo selection is in. Expect stunning urban shots, nature's quiet beauty, and a truly cosmic wonder.

Summer Games Done Quick 2026 Lineup Celebrates Speedrunning

SGDQ 2026 kicks off July 5 in Minneapolis, featuring both classic and quirky speedruns. Proceeds support Doctors Without Borders.

WordPress Funnel Builder Bug Exposes 40K Sites to Card Theft

A vulnerability in Funnel Builder for WordPress allows attackers to steal credit card data from over 40,000 WooCommerce sites. Update now!

Tesla Reveals Teleoperator Crashes in Austin Robotaxi Tests

Tesla admits two Robotaxi crashes in Austin involving teleoperators. The incidents highlight challenges in its autonomous network expansion.